EU AI Wet: dit moet je weten

Het is een feit, de AI-wet is goedgekeurd door het Europese Parlement. Nadat de EU-landen in december 2023 deze regelgeving accepteerden, is in maart 2024 de wet ook door het Europese Parlement aangenomen. Deze AI-wet heeft grote impact op het gebruik en de ontwikkeling van AI binnen Europa.

In deze blog vertel ik wat je moet weten over de Europese AI-wet, hoe deze wet Europese tech innovatie mogelijk beïnvloedt, en wie verantwoordelijk is wanneer de wet niet wordt nageleefd.

Waarom een EU AI wet?

In april 2021 deed de Europese Commissie een voorstel voor Europese wetgeving met betrekking tot AI (kunstmatige intelligentie). De Europese Commissie is het uitvoerend orgaan van de Europese Unie dat onder andere het EU-recht handhaaft. Deze commissie heeft zicht op hoe de maatschappij zich ontwikkelt en hoe de wetgeving daarop aansluit. Wanneer er een gat zit tussen de actualiteit en de wetgeving, en rechtszaken daardoor niet goed genoeg behandeld kunnen worden, kan de Europese Commissie een wetsvoorstel doen, zoals in het geval van de AI-wet.

Al langere tijd wordt er wetenschappelijk onderzoek gedaan naar hoe ontwikkelingen rondom kunstmatige intelligentie de maatschappij beïnvloeden. Deze onderzoeken gaan voornamelijk over de Verenigde Staten maar er zijn ook diverse onderzoeken die wel naar de ontwikkeling van AI in Europa kijken. Dit wetenschappelijk onderzoek is van groot belang voor de EU om te bepalen wat er moet gebeuren. Het Europese rechtssysteem werkt namelijk anders dan het rechtssysteem van bijvoorbeeld de VS en de UK.

Dat de Europese Commissie in 2021 het voorstel voor de AI-wet deed, is geen verrassing. Tegen die tijd waren er genoeg onderzoeken die bewezen dat kunstmatige intelligentie en de mogelijkheid om processen automatiseren vragen om een toevoeging aan de bestaande wetgeving. Wetgeving voor AI rondom discriminatie, veiligheid en de gevolgen daarvan zijn goede voorbeelden van de noodzaak voor de ontwikkeling van AI-wetgeving. In deze blog zet ik met name gevaren rondom discriminatie uiteen.

Discriminatie

Discriminatie is per wet verboden in de Europese Unie. Deze wet, artikel 21 van het EU-handvest van de grondrechten, heet de non-discriminatiewet en omvat het volgende:

“Iedere discriminatie, met name op grond van geslacht, ras, kleur, etnische of sociale afkomst, genetische kenmerken, taal, godsdienst of overtuiging, politieke of andere denkbeelden, het behoren tot een nationale minderheid, vermogen, geboorte, een handicap, leeftijd of seksuele gerichtheid, is verboden.”[1]

Contextual Equality

Een onderzoek uit 2020 toont het hiaat tussen de non-discriminatiewet van de EU en de ontwikkelingen van AI. Wetgeving over discriminatie door AI moet anders worden aangepakt dan wetgeving over discriminatie door mensen. In de huidige wetgeving rondom discriminatie berust een groot gedeelte van de wet op ‘contextual equality’: wanneer iemand (of in het geval van de EU vaker een bedrijf of overheid) wordt aangeklaagd voor discriminatie, dan wordt per zaak bekeken hoe daarmee om wordt gegaan.[2]

De uitspraak van zo’n zaak is afhankelijk van wat er precies gebeurd is, wat de feiten zijn, of er sprake is van bewuste of onbewuste discriminatie, op welke schaal de gevolgen merkbaar zijn, enzovoort. Er is veel ruimte voor interpretatie en dat is goed, want zulke zaken zijn zelden één-op-één te vergelijken. Pas na zorgvuldig onderzoek wordt besloten of de aangeklaagde een straf krijgt of niet.

In het geval van AI is dit een stuk moeilijker. Je zou misschien zo’n onderzoek wel kunnen uitvoeren, maar wie houd je precies verantwoordelijk?

HireVue

Een bekend voorbeeld is het Amerikaanse HireVue. HireVue is een softwareprogramma dat door organisaties gebruikt wordt in werving- en selectieprocessen van nieuwe medewerkers.[3] Het is in de Verenigde Staten maar ook in Europa gebruikt voor miljoenen sollicitaties bij grote bedrijven als Unilever. Met HireVue worden kandidaten getoetst met AI, bijvoorbeeld door gamified testen te doen maar ook door filmpjes op te nemen waarin de kandidaten vragen beantwoorden.

Deze tests en filmpjes worden door AI beoordeeld aan de hand van eerder opgegeven metrics. Deze metrics kunnen kwaliteiten zijn waar de ideale kandidaat voor die positie aan voldoet. In het AI-sollicitatieproces wordt de daadwerkelijke kandidaat getest aan de hand van de metrics om vervolgens een score te krijgen hoe hij of zij heeft gepresteerd. Handig! Dit scheelt deze bedrijven veel werk om duizenden sollicitaties door te spitten. Met het automatiseren van het system en het zorgvuldig invullen van je wensen kan AI je perfect helpen. Of toch niet?

Menselijke maat

Bij geautomatiseerde sollicitatieprocessen missen we de menselijk maat die juist zo belangrijk is om organisaties zo divers en inclusief mogelijk te maken. Modellen die gebruikt worden door AI zijn getraind op gemiddelden. Hierdoor ontstaat het risico dat we alleen gemiddelden selecteren, wat juist in strijd is met diversiteit. Naast het probleem met gemiddelden, zijn er ook andere problemen met geautomatiseerde selectieprocessen. Hoe maken mensen die minder mobiel zijn een gamified test? En hoe zit het met mensen die slecht kunnen zien? Met het gebruik van software waarin iedereen aan dezelfde voorwaarden wordt gehouden (of ieder geval met dezelfde mogelijkheden moet werken) sluit je automatisch mensen buiten.

Mensen hebben ook bewust of onbewust vooroordelen. AI zou, mits de modellen juist getraind worden, zeker kunnen helpen om grote hoeveelheden sollicitaties te beoordelen en misschien minder onbewust vooroordelen uitdragen. Maar, zorg wel voor een goede evaluatie van het model en wees kritisch: krijg je de juiste mensen binnen om je diversiteitsdoelen te halen?

Ondoorzichtige resultaten

Kunstmatige intelligentie, chatbots en automatiseringen bouwen voort op wat al bestaat en op ontwikkelingen in real-time. Doormiddel van algoritmes en kansberekeningen neemt AI-software nieuwe kennis op en worden slimme programma’s steeds slimmer. Het probleem is dat gebruikte modellen steeds complexer en groter worden. Zo groot, dat niet duidelijk meer is wat er in zo’n model gebeurd. Bedrijven achter de AI-software, zoals Hire-Vue of OpenAI voor Chat-GPT, kunnen de door het model genomen beslissingen niet meer verklaren. Dit zorgt ervoor dat het niet duidelijk is waarom een Hire-Vue kandidaat wordt aangenomen of afgewezen. Dit is in geen geval wenselijk. Maar het wordt zorgelijk wanneer blijkt dat een specifieke groep mensen systematisch en consequent wordt afgewezen of op een andere manier wordt benadeeld. Dan is er sprake van (institutionele) discriminatie.

Maar, wie is hiervoor verantwoordelijk? Het algoritme, het bedrijf dat achter de software zit, de organisatie dat van de software gebruik maakt of het individu dat de goedkeurig geeft om AI op deze manier te gebruiken?

Met de EU AI Act wil de Europese Commissie EU-burgers beschermen tegen de negatieve consequenties van kunstmatige intelligentie, zoals discriminatie en ondoorzichtigheid van processen en resultaten.

EU AI Act

Door voorbeelden als Hire-Vue, heeft de Europese Commissie in 2021 een wetsvoorstel gedaan om Europese AI wet- en regelgeving te ontwikkelen. Deze EU AI-wet is een framewerk met als doel het gebruik van kunstmatige intelligentie in de gehele EU te reguleren om veiligheid, betrouwbaarheid en transparantie te waarborgen. Het heeft direct gevolgen voor het bewaken van de rechtstaat en de non-discriminatiewet.

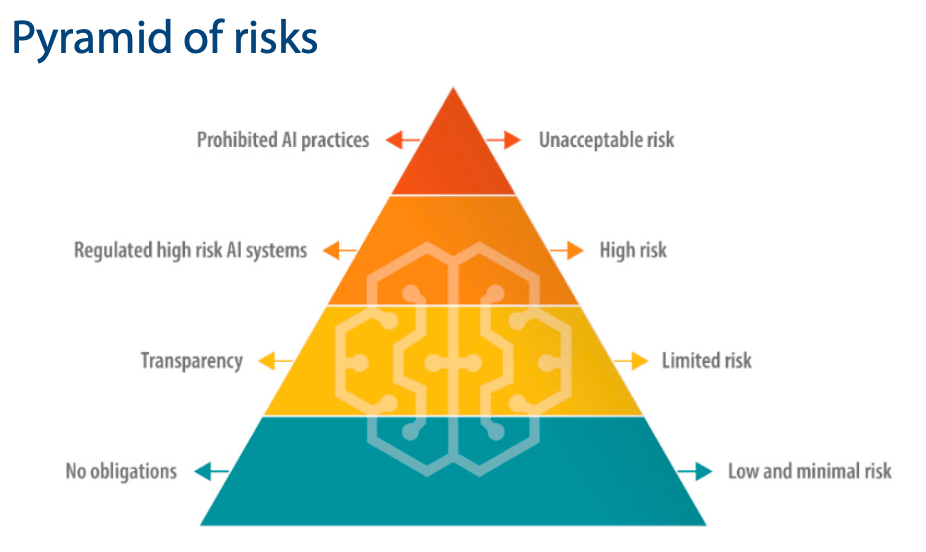

Om de AI-wet zo goed mogelijk door te voeren, en de Europese waarden die ik eerder heb uitgelegd als ‘contextual equality’ te waarborgen, heeft de Europese Commissie een voorstel gedaan voor een ‘risk based’-methode. AI-gebruik wordt geclassificeerd op basis van het risico dat het meebrengt voor veiligheid, betrouwbaarheid en transparantie. Hoe groter het risico, hoe strenger de veiligheidseisen en hoe groter de kans op een verbod.

Dat ziet er zo uit:

- Onaanvaardbaar risico, bijvoorbeeld in social scoring of biometrische identificatie op afstand.

- Hoog risico, bijvoorbeeld AI-gebruik tijdens het sollicitatieproces of wetshandhaving, AI-gebruik met medische apparatuur of deep fakes.

- Laag risico, bijvoorbeeld de spamfilter in je inbox of interactie met chatbots.

In december 2023 werd de AI-wet met deze en een opgestelde definitie van wat een AI-systeem precies goedgekeurd door de Europese lidstaten. Dit is een politieke overeenkomst dat officieel goedgekeurd moet worden door het Europese Parlement. In 2023 nam de EU deze definitie aan van een AI-systeem:

“A machine-based system that generates output such as predictions, content, recommendations or decisions influencing physical or virtual environments, inferring it from the input the system receives. These systems can vary in their levels of autonomy and adaptiveness.”[4]

Behalve dat AI-gebruik wordt ingeschaald op risiconiveau en dat organisaties die hiermee werken moeten voldoen aan desbetreffende veiligheidseisen, moeten organisaties onder de AI Act ook een verklaring geven voor elke uitkomst van AI-gebruik en voor het besluitvormingsproces achter deze uitkomsten. Hierdoor wordt gebruik van software als Hire-Vue aan banden gelegd omdat zij zelf geen idee hebben waar sommige uitkomsten op gebaseerd zijn.

Status in 2024 en innovatie aan banden?

In maart 2024 werd de EU AI-wet goedgekeurd door het Europese Parlement met een grote meerderheid (523 stemmen voor, 46 tegen en 49 onthoudingen). Het Europese Parlement is de volksvertegenwoordiging van de Europese Unie, dat elke vijf jaar doormiddel van verkiezingen door het Europese volk wordt gekozen.[5]

Hoewel de AI-wet het doel heeft om de burger op allerlei verschillende wijze te beschermen tegen de negatieve consequenties van de AI, claimt de Europese Commissie dat met deze wet de ontwikkeling en innovatie van AI niet wordt gestremd. Dit is een groot ding, omdat de AI-ontwikkeling in de Verenigde Staten, het Verenigd Koninkrijk en andere delen van de wereld niet wordt gestuurd door vergelijkbare wetgeving. Het risico is dat Europese landen op termijn niet mee kunnen komen met de snelle ontwikkeling van AI en niet tegen concurrentie van elders kunnen opboksen.

In januari 2024 heeft de Europese Commissie een AI-innovatie pakket vrijgegeven om de ontwikkeling van kunstmatige intelligentie binnen start-ups en MKB’s te ondersteunen. Dit pakket omvat niet alleen aanspraak op financiële ondersteuning, maar maakt ook het gebruik van Europese supercomputers toegankelijker, om zo het gebruik en de ontwikkeling van AI met Europese normen en waarden mogelijk te maken. De Europese ‘AI Office’ is hier ook onderdeel van. Dit is een officieel orgaan dat niet alleen de wet- en regelgeving omtrent AI in de gaten houdt, maar ook de ontwikkeling van AI binnen de EU bevordert.[6]

In werking treden van de wet

Dat het Europese Parlement de AI-wet heeft goedgekeurd, wil niet zeggen dat de wet gelijk morgen in werking treedt. De wet moet eerst nog door een proces heen, bijvoorbeeld om alles wettelijk te checken en vast te leggen. Nadat dit is gebeurd en nadat de wet officieel gepubliceerd is, treedt de wet in werking en moeten Europese organisaties zich eraan houden. Dit gebeurt niet in een keer: pas na 24 maanden is de wet volledig toepasbaar, met volgende uitzonderingen[7]:

- 6 maanden na publicatie van de wet is AI-gebruik dat verboden is strafbaar;

- 9 maanden na publicatie van de wet is het gebruik van AI dat niet overeenkomt met de ethische gedragsregels van de EU strafbaar;

- 12 maanden na publicatie van de wet zijn de algemene AI-regels inclusief AI-governance strafbaar;

- 36 maanden na publicatie van de wet is het niet houden aan de verplichtingen gesteld aan hoog risico AI-gebruik strafbaar.

De verwachting is dat in 2025 de eerste gevolgen van de EU AI-wet merkbaar zijn.

Conclusie

Ondanks dat de EU AI-wet is goedgekeurd, is het nog een work-in-progres. De exacte uitwerkingen van de wet zijn nog niet duidelijk, en dit zal pas blijken wanneer de wet daadwerkelijk in werking treedt. De richtlijnen waar je als organisatie aan moet voldoen worden natuurlijk wel steeds duidelijker.

Een grote zorg rondom de AI-wet is hoe het invloed gaat hebben op tech-innovatie binnen de Europese Unie. Het Europese Parlement heeft ingestemd met het doel dat deze wetgeving de toepassing van AI moet reguleren, maar ook moet stimuleren. Daarom heeft de Europese Commissie een AI-innovatie pakket beschikbaar gemaakt. De toekomst zal ons leren wat de gevolgen van de wet zijn. Feit is wel: hoe minder er gebruik gemaakt mag worden van AI, hoe minder snel ontwikkeling gaat. Er moet getoetst en getest worden om innovatie mogelijk te maken, en zeker op het gebied van kunstmatige intelligentie moet er nog veel geleerd en ontdekt worden. Als dit niet mogelijk is, zal de Europese tech-industrie hier de gevolgen van merken. Het is zeker dat tech-bedrijven uit andere regio’s dan wel innovatieve AI-software ontwikkelen die tevens aansluit op de Europese wetgeving.

De ontwikkeling van AI is de afgelopen jaren enorm snel gegaan. Dit maakt de urgentie voor een wet als de EU AI-wet een feit. De vraag is: kan de Europese Commissie en het rechtssysteem de ontwikkeling van AI bijhouden? Het voorstel van deze wet door de Europese Commissie werd in het voorjaar in 2021 gedaan. Naar verwachting treedt de wet pas in 2026 of 2027 volledig in werking. Wie weet waar de ontwikkeling van AI ons dan heeft gebracht.

Terugkomend op de vraag wie er verantwoordelijk wordt gehouden bij AI-gebruik dat niet aan de AI-wet voldoet: het algoritme, het bedrijf dat achter AI-software zit, de organisatie dat er gebruik van maakt of het individu dat de goedkeurig geeft om AI op deze manier te gebruiken? Het antwoord: de organisatie dat er gebruik van maakt. Belangrijk is dus om je zaakjes goed op orde te hebben. Weten hoe Luminis jouw organisatie kan helpen? Neem contact op met Jettro Coenradie.

Bronnen

[1] https://www.europarl.europa.eu/news/en/press-room/20240308IPR19015/artificial-intelligence-act-meps-adopt-landmark-law

[2] Wachter, Mittelstadt en Russell. “Why Fairness Cannot Be Automated.” 2020. https://arxiv.org/ftp/arxiv/papers/2005/2005.05906.pdf

[3] Schnellman, Hilke. “The Algorithm.” 2024.

[4] https://fra.europa.eu/nl/eu-charter/article/21-non-discriminatie.

[5] https://www.euractiv.com/section/artificial-intelligence/news/oecd-updates-definition-of-artificial-intelligence-to-inform-eus-ai-act/

[6] https://www.europarl.europa.eu/news/en/press-room/20240308IPR19015/artificial-intelligence-act-meps-adopt-landmark-law

[7] https://digital-strategy.ec.europa.eu/nl/policies/ai-office

Meer weten over wat wij doen?

We denken graag met je mee. Stuur ons een bericht.